将AI应用在学习中,就相当于有一个随时在身边的高级讲师,每个人都可以成为学习专家,这是最近我将其应用在日常的英语学习中的感受。英语学习4门功课:听说读写。其中相对较差的是听说,因为学校中接受的应试教育,完全偏向了读与写。无论是进入大学的高考,还是大学毕业后考研,对英语科目的考试,重点内容只有阅读和写作。

能用英语完成阅读和写作,并不意味着能够顺利对话,我自己也是多年来的「哑巴英语」(观察身边的大部分人,也基本都是如此)。我使用AI模型首先想提升的就是英语听力和口语能力。

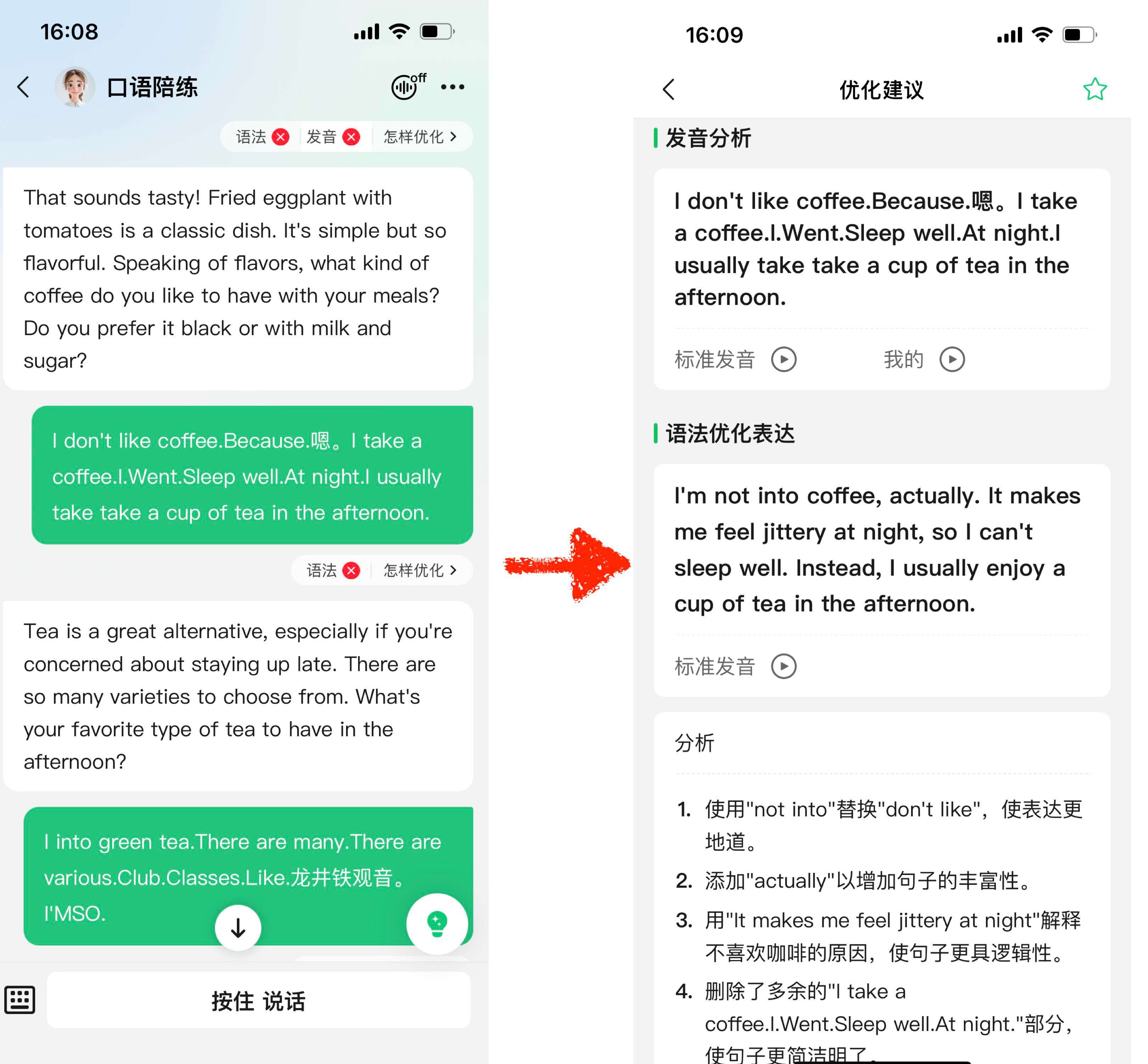

1.口语陪练

口语陪练是App元宝中的一个智能体,打开后,可以像微信中的语音消息一样,按住语音按钮直接说英语,然后发送给它。它会根据你的消息,立刻回复给你对应的英文,如同一个身边的英语外教。而且,为了减少对话压力,可以提前设定它的难度范围,比如我设定的「大学英语四级」难度。

怕说错?没关系。每一段语音输入后,它会按照地道地英语口语标准,立即进行批改和纠正。

怕说的不好,对方听不懂或者不知如何接话而尴尬?不会的,他就像一个话唠,无论你说什么,他都能顺着你的意思来回复,并且抛出对应场景的新问题,引导对话的继续。

前面一段时间,我每天睡觉前都会花费半小时的时间和它聊天。就聊当天的生活小事儿,比如今天喝了一杯绿茶提神,和队友打乒乓球,举办生日聚会,小孩儿为什么喜欢看门口的车杆...每个场景它的回复,都有让我惊喜的地方。就是那种每个单词,你都认识,可是让自己去表述,绞尽脑汁却都想不出来的感觉。

使用一段时间下来,发现也有用户体验不太好的地方。一个是与它的对话内容,无法导出。另一个是即便自己去一段一段地复制粘贴去保存时,它对单句语音批改后的内容,也不支持复制,我只能一个一个单词的抄写下来。对我这种想要再一次诵读对话的需求,很不友好。

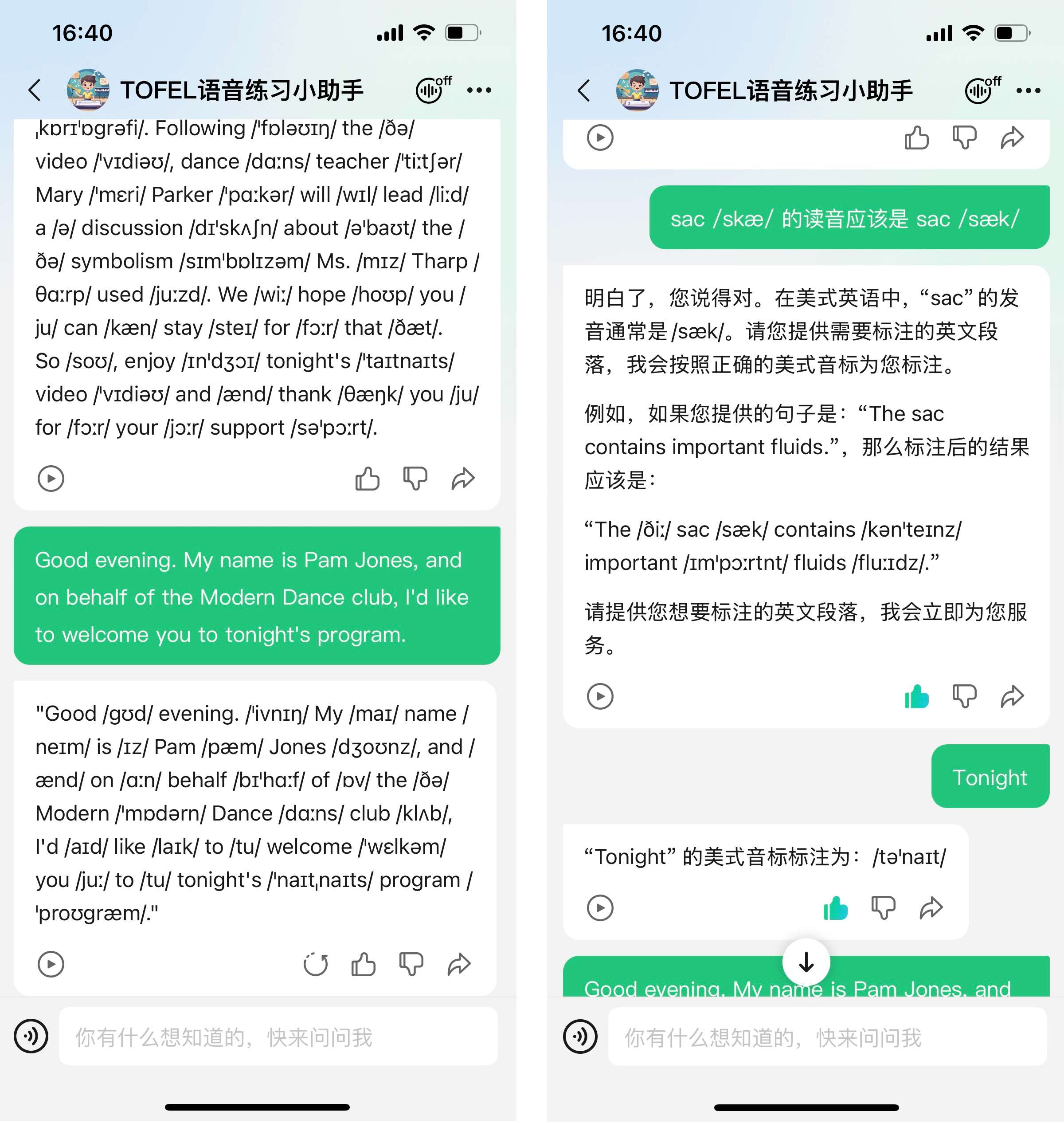

2. 标注音标

看到过一个英语口语进步的方法,就是朗读。可是对大段的英文,如果按照自己以往的读音朗读,仍然会继续错误地呆在原地,就像你用家乡话朗诵,无论多么努力,别人听不清的地方依然是听不清。一个可行的纠正方式,就是查出一个一个单词的读音,就像朗读普通话时,每个字的上方都标上拼音一般。这个重复的体力活,怎么能自己做呢?当然是交给AI。

我建立了一个英语音标标注的智能体,只要将整段英文发送给它,他就会按照美式音标的标准,对每一个单词进行音标标注,并且按照我设置好的格式回复。下面是最终效果:

照着标注好的语音,再去朗读整段英文,错误的读音就能大大减少。当然,它返回的标注结果,使用过程中,我发现也并不是全部正确。个别单词是直接错误,个别单词使用了英语音标,所以朗读时感到不顺的地方,还需要重新查询字典(我一般用有道)进行确认。不过整体已经方便太多。

我会将一些查询到的错误反馈给它,以帮助它进行不断完善。因为我们对模型使用中,它都会带有一定的上下文,这样下次它的语音标注就能避免再次犯同样的错误。数据的意义就在于此,通过不断反馈和迭代,AI会越来越好用,这样又会带来更多的数据反馈...未来的世界真的无法想象。

3. 收获

使用以上的两个智能体进行一段时间的英语口语学习,自我感觉很不错。至少在孩子面前,我开始能顺利地念出绘本上的单词和对话。而且也开启了关注其他的英语学习资源和方法。现在的推荐算法,你一旦开始某个兴趣点儿,相关的消息就会如雪花般不断飘来。

智能体的建立过程,提示词我是通过kimi完成的。将kimi生成的提示词发送给它自身,它的回复却没有符合我的预期,反而是发送给元宝,得到了较好的结果。可能是模型训练数据导致的差异,kimi、元宝、豆包等AI都有自己擅长的地方,同时也有自己较弱的一面。作为用户的我们,在使用中如果遇到了很奇怪的问题,倒不妨试试换个模型,说不定就会有意外收获。

现在AI的使用越来越深入到生活和工作的不同场景中,辅助编程、绘画生成早已在路上,智能助手又是无数不在,马斯克的智能驾驶和机器人也要落地了。我现在有什么问题,第一反应就是问AI,感觉已经替换掉原来下意识地搜索了。前面看豆包的1024码上奇妙夜直播,被采访各个大神形成了一种统一的认识——积极拥抱AI,这也是我近来的感受,分享给看到的朋友。

PS:

- 想要使用以上智能体的朋友,直接搜索TOFEL语音练习小助手使用即可。

- 关于用AI助力学习英语,除了听说,读写也一样可以。比如批改作文,特定主题的新闻收集等,待我实践有些成果后,再详细总结分享下。